L’etica dell’auto a guida autonoma

Il famigerato “problema del carrello ferroviario” è stato presentato a milioni di persone in uno studio globale, rivelando quanto l’etica diverga tra le culture di un paese e l’altro.

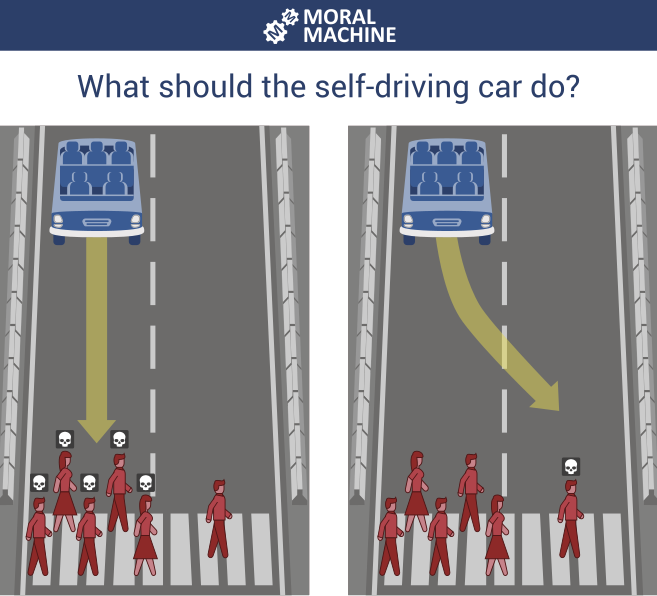

Nel 2014 i ricercatori del MIT Media Lab hanno progettato un esperimento chiamato Moral Machine. L’idea era quella di creare una piattaforma simile a un gioco che potesse raccogliere in crowdsourcing le decisioni delle persone su come le auto a guida autonoma dovrebbero dare la priorità alle vite in diverse varianti del “problema del carrello“. Nel processo, i dati generati fornirebbero una visione delle priorità etiche collettive delle diverse culture.

I ricercatori non avevano previsto la ricezione virale dell’esperimento. Quattro anni dopo la pubblicazione della piattaforma, milioni di persone in 233 paesi e territori hanno registrato 40 milioni di decisioni, rendendolo uno dei più grandi studi mai condotti sulle preferenze morali globali.

Un nuovo articolo pubblicato su Nature presenta l’analisi di quei dati e rivela quanto l’etica interculturale diverga sulla base della cultura, dell’economia e della posizione geografica.

Il classico problema del carrello ferroviario è questo: vedi un carrello in fuga che sfreccia lungo i binari, sul punto di colpire e uccidere cinque persone. Hai accesso a una leva che potrebbe portare il carrello su un binario diverso, dove una persona diversa incorrerebbe in una scomparsa prematura. Dovresti tirare la leva e porre fine a una vita per risparmiarne cinque?

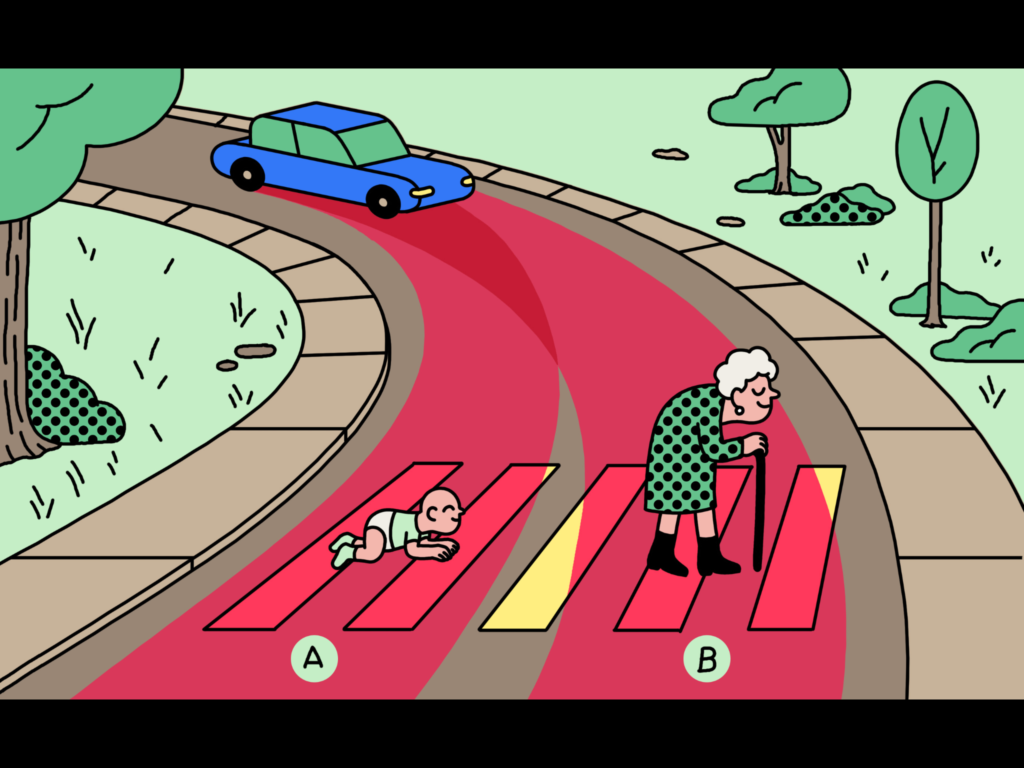

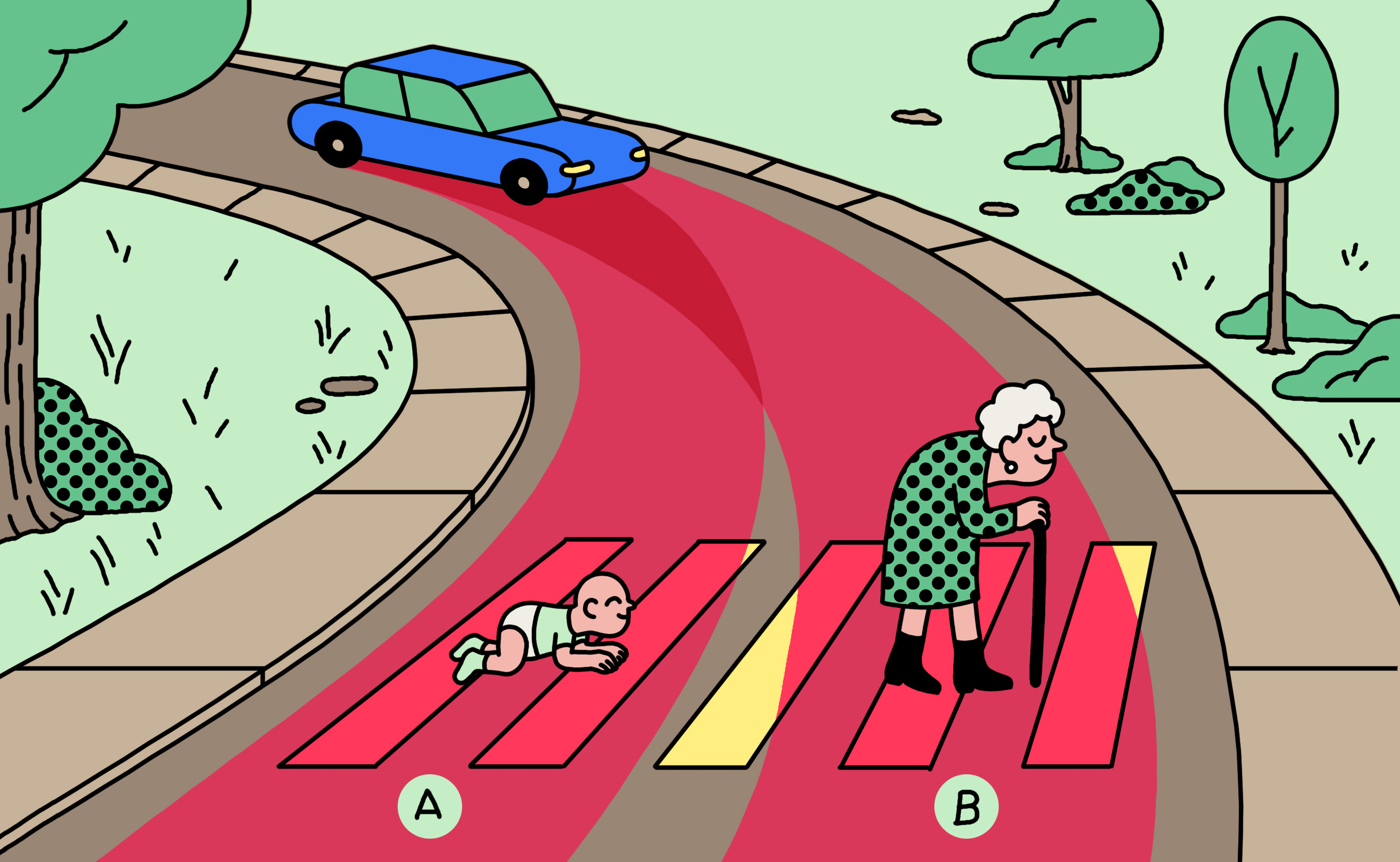

The Moral Machine ha preso questa idea per testare nove diversi confronti che hanno dimostrato di polarizzare le persone: un’auto a guida autonoma dovrebbe dare la priorità agli esseri umani rispetto agli animali domestici, i passeggeri ai pedoni, più vite su meno, donne sugli uomini, giovani su vecchi, in forma status su persone inferiori, rispettosi della legge rispetto a violatori della legge? E infine, l’auto dovrebbe sterzare (agire) o rimanere sulla rotta (inazione)?

Invece di porre confronti uno a uno, tuttavia, l’esperimento ha presentato ai partecipanti varie combinazioni, ad esempio se un’auto a guida autonoma debba continuare dritto per uccidere tre pedoni anziani o deviare in una barricata per uccidere tre passeggeri giovani.

I ricercatori hanno scoperto che le preferenze dei paesi differiscono ampiamente, ma sono anche fortemente correlate con la cultura e l’economia. Ad esempio, i partecipanti di culture collettiviste come Cina e Giappone hanno meno probabilità di risparmiare i giovani rispetto ai vecchi, forse, ipotizzano i ricercatori, a causa di una maggiore enfasi sul rispetto degli anziani.

Allo stesso modo, i partecipanti provenienti da paesi più poveri con istituzioni più deboli sono più tolleranti nei confronti dei jaywalker rispetto ai pedoni che attraversano legalmente. E i partecipanti provenienti da paesi con un alto livello di disuguaglianza economica mostrano maggiori divari tra il trattamento degli individui con uno status sociale alto e basso.

E, in ciò che si riduce alla questione essenziale del problema del carrello, i ricercatori hanno scoperto che il numero di persone in pericolo non è sempre stato il fattore dominante nella scelta del gruppo da evitare. I risultati hanno mostrato che i partecipanti provenienti da culture individualistiche, come il Regno Unito e gli Stati Uniti, hanno posto una maggiore enfasi sul risparmio di più vite date tutte le altre scelte, forse, secondo il punto di vista degli autori, a causa della maggiore enfasi sul valore di ogni individuo.

Anche i paesi vicini l’uno all’altro hanno mostrato preferenze morali più strette, con tre gruppi dominanti a ovest, est e sud.

I ricercatori hanno riconosciuto che i risultati potrebbero essere distorti, dato che i partecipanti allo studio erano auto-selezionati e quindi avevano maggiori probabilità di essere connessi a Internet, di alto livello sociale e esperti di tecnologia. Ma è probabile che anche coloro che sono interessati a guidare auto a guida autonoma abbiano queste caratteristiche.

Lo studio ha implicazioni interessanti per i paesi che attualmente stanno testando auto a guida autonoma, poiché queste preferenze potrebbero svolgere un ruolo nel plasmare la progettazione e la regolamentazione di tali veicoli. Le case automobilistiche potrebbero scoprire, ad esempio, che i consumatori cinesi entrerebbero più facilmente in un’auto che si proteggesse dai pedoni.

Ma gli autori dello studio hanno sottolineato che i risultati non intendono dettare il modo in cui i diversi paesi dovrebbero agire. In effetti, in alcuni casi, gli autori hanno ritenuto che i tecnologi e i responsabili politici dovrebbero prevalere sull’opinione pubblica collettiva. Edmond Awad, un autore dell’articolo, ha portato come esempio il confronto dello status sociale. “Sembra preoccupante che le persone abbiano trovato che va bene in misura significativa per risparmiare uno stato superiore rispetto a uno stato inferiore”, ha detto. “È importante dire” Ehi, potremmo quantificarlo “invece di dire:” Oh, forse dovremmo usarlo “.” I risultati, ha detto, dovrebbero essere usati dall’industria e dal governo come base per capire come il pubblico reagirebbe all’etica delle diverse decisioni di progettazione e politica.

Awad spera che i risultati aiuteranno anche i tecnologi a pensare più profondamente all’etica dell’IA oltre alle auto a guida autonoma. “Abbiamo utilizzato il problema del carrello perché è un ottimo modo per raccogliere questi dati, ma speriamo che la discussione sull’etica non rimanga all’interno di quel tema”, ha detto. “La discussione dovrebbe passare all’analisi del rischio, su chi è a più o meno rischio, invece di dire chi morirà o no, e anche su come stanno accadendo i pregiudizi”. Il modo in cui questi risultati potrebbero tradursi in una progettazione e regolamentazione più etiche dell’IA è qualcosa che spera di studiare di più in futuro.

“Negli ultimi due, tre anni più persone hanno iniziato a parlare dell’etica dell’IA”, ha detto Awad. “Sempre più persone hanno iniziato a rendersi conto che l’intelligenza artificiale potrebbe avere conseguenze etiche diverse su diversi gruppi di persone. Il fatto che vediamo persone impegnate in questo, penso che sia qualcosa di promettente